-

-

Introducción

La historia de la técnica corre paralela con la historia de la humanidad. El ser humano es un animal racional, lo que le conduce a ser un animal tecnológico.

El homo faber es anterior al homo sapiens y esta capacidad de hacer le permitió transformar el medio que le rodea, en lugar de adaptarse a él como han hecho otros animales. Tampoco le hubiera sido fácil adaptarse al medio y sobrevivir pues se encontraba con otros animales con mejores defensas, piel más resistente, incisivos más potentes, garras más eficaces, mayor velocidad y mejor agilidad.Sin embargo, el hombre contaba con tres facultades: imaginación, habilidad manual y lenguaje, que controladas adecuadamente por otras facultades superiores como la razón y la inteligencia le permitirían transformar el entorno.

La imaginación le permitió al hombre crear dentro de sí las herramientas que necesitaba para sobrevivir en un ambiente hostil. Con su habilidad manual, según Franklin “man is a tool making animal”, el hombre consiguió construir esas herramientas, acumulando en ellas la potencialidad que le faltaba en la acción directa.El lenguaje le permitió conservar y transmitir sus conocimientos, así como la transmisión de información en el tiempo. En la transmisión de información en el espacio el hombre primitivo era superado por otros animales, que lo hacían a mayores distancias por su mayor potencia. Sin embargo, el lenguaje y la memoria le permitieron desde el principio ser superior en la transmisión de información a través del tiempo.

El cálculo no participaba de la vida del hombre primitivo, probablemente todas sus capacidades se reducían a contar con los dedos de la mano. Durante los grandes imperios orientales se conocían algunos sistemas de numeración pero no orientados hacia el cálculo.

-

Hace por lo menos 3000 años

El ábacoEl ábaco de polvo constituye la más antigua herramienta de cálculo conocida y se remonta a la llamada cuna de la civilización hace por lo menos 5000 años en el Valle del Tigris-Eufrates, al suroeste de Asia.

-

Antes del descubrimiento de América

Calculadoras astronómicasAproximadamente 3000 años antes del descubrimiento de América se construye el observatorio de Stonehenge en Inglaterra. Este monumento, compuesto de círculos concéntricos hechos de piedras gigantescas, sigue siendo un enigma para los arqueólogos.

-

Edad media

Poco antes de llegar al año 1000, el sacerdote francés Gerbert de Aurillac es traído por el conde de Borrell al monasterio de Ripoll, donde lleva a cabo el primer intento en la Europa Occidental de mecanizar el ábaco.

-

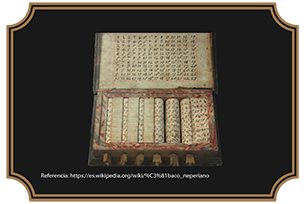

1616

Las máquinas de Napier y Schickard.El descubridor del logaritmo, John Napier (1550-1617), barón de Merchiston en Escocia, desarrolló en 1614 un aparato conocido como las varillas o huesos de Napier que era una tabla de búsqueda de resultados para las multiplicaciones.

-

1642

La Pascalina.La primera calculadora la inventó un joven francés llamado Blaise Pascal (1623- 1662) en 1642. Era hijo de un recaudador de impuestos y buscaba la forma de reducir el tedioso trabajo de sumar grandes cantidades de números.

-

1695

Los avances de Leibnitz.Para empezar, Gottfried Wilhelm Leibnitz (1646-1716) mejoró la máquina de Pascal, añadiéndole un cilindro escalonado de dientes de longitud variable, conocida ahora como rueda de Leibnitz para representar los dígitos del 1 al 9.

-

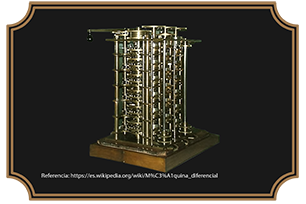

1832

La máquina analítica de Babbage.La idea que tuvo el inglés Charles Babbage (1791-1871) de un ordenador tuvo su origen en el hecho de que la elaboración de tablas matemáticas era realmente frustrante por ser un proceso tedioso y tendiente a errores.

-

1854

La lógica de BooleEn 1854 el matemático inglés George Boole (1815-1864) sienta las bases de lo que conocemos hoy como Teoría de la Información, con la publicación de su obra maestra, “Una Investigación de las Leyes del Pensamiento” sobre las cuales se fundamentan las Teorías Matemáticas de la lógica y las probabilidades.

En su obra, Boole expresa la lógica como una forma extremadamente simple de álgebra, en la cual se lleva a cabo el razonamiento mediante la manipulación de fórmulas más sencillas que aquéllas utilizadas en el álgebra tradicional.

-

Mitad del siglo XX

Los dispositivos electromecánicosLos aparatos más eficientes en el ámbito del cálculo científico y militar en la primera mitad del siglo XX empleaban la hoy en desuso tecnología analógica.

-

1939

La aparición de la electrónicaPero el cambio tecnológico radical fue el uso de la electrónica, cuyo precursor fue el profesor John Vincent Atanasoff de la Universidad de Iowa junto con su compañero Clifford Berry.

Su máquina de calcular, conocida como ABC (Atanasoff Berry Computer), fue creada en 1939, estaba basada en el uso de tubos de vacío y operaba en binario.

-

1945

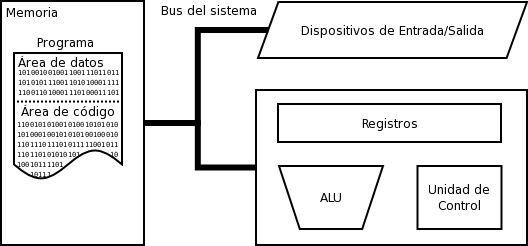

Las bases de John Von Neumann.La incorporación del matemático John Von Neumann (1903-1957) al equipo de diseño hizo que la idea del programa almacenado en la memoria en formato binario junto con los datos, que hoy caracteriza al ordenador y que se conoce como arquitectura Von Neumann, se le atribuyera sólo a él, cuando es casi seguro que fue un diseño de Eckert y Mauchly al que Neumann dio forma escrita.

-

Generaciones tecnológicas de ordenadores

Muy rápidamente, al instalarse este tipo de ordenadores en departamentos de universidades y laboratorios de investigación, se creó una necesidad de mayor velocidad, mayor capacidad y mayor fiabilidad que motivó un esfuerzo intensísimo por nuevos dispositivos y el desarrollo de nueva tecnología.

Suele dividirse los siguientes años de historia de ordenadores digitales en diversas generaciones que corresponden con las distintas tecnologías dominantes en cada caso.

-

Lenguajes de programación

Necesidad de los lenguajes de programación.Hasta la aparición de los circuitos integrados a gran escala, la tecnología continúa sus desarrollos a una velocidad considerable mientras el desarrollo de programas y sistemas operativos no parece alcanzar esta velocidad.

Los lenguajes máquina están fuertemente relacionados con el diseño constructivo de los elementos o microcircuitos electrónicos que forma el procesador.Los programas escritos en lenguajes máquina sólo son transportables a otra máquina que posea exactamente el mismo modelo de procesador y una configuración física totalmente equivalente o compatible.

Aunque se recurra a la compactación del binario a octal o hexadecimal, la programación en lenguaje máquina es tediosa exigiendo una gran minuciosidad y paciencia.

-

Lenguajes simbólicos de programación.

Por todo lo anterior quedó claro desde la primera generación de ordenadores, la necesidad de recurrir a lenguajes simbólicos de programación. Estos lenguajes recorren un amplio espectro, desde los ensambladores de bajo nivel, pasando por los lenguajes de alto nivel hasta los lenguajes de cuarta generación. La historia de los lenguajes de programación es relativamente corta pero extensa y prolija.

-

Años 50

Los primeros lenguajes.Los primeros trabajos comienzan en la década de los años 50, con un compilador de lenguaje llamado A2, segunda versión de un fracasado A1, desarrollado por Grace N. Hooper (1907-1992) para UNIVAC.

Se suele entender como un lenguaje de programación de propósito general, un lenguaje orientado a la selección y provisión de expresiones del máximo poder lógico, entre aquellos lenguajes en los que utilizando las técnicas de optimización habituales consiguen compilaciones que proveen un eficiente código de máquina.

-

Primeras estructuras

Desde la aparición de los primeros ordenadores se han utilizado tablas y listas lineales como estructuras soporte de los datos, el almacenamiento de estas estructuras se hacía en direcciones adyacentes de memoria.

Paralelamente a la utilización de estas estructuras se construyeron los algoritmos básicos para el tratamiento de listas y tablas (Jonh Von Neumann).

-

Algoritmos de ordenación

El diseño y desarrollo de algoritmos tiene un origen asociado al de numerosas disciplinas (la matemática, la física…) ya que la construcción progresiva de la solución a un problema está intrínsecamente ligada a la naturaleza de muchas ciencias.

-

Informática ubicua

El futuroParece que la tendencia general que se orienta hacia lo que se denomina ya la informática ubicua, con sistemas que incluyen capacidad de proceso en muchos dispositivos que, por su número y ubicuidad, pronto van a dejar de ser considerados como ordenadores.

-

Referencias

• ACM/IEEE-CS. (1990) Joint Curriculum Task Force Computing. Curricula 1991 Report. Consultado el

5-09-2016 de la página web: http://www.computer.org/education/cc1991/

• Beekman, G. (1995). Computación & Informática Hoy. Ed. Addison Wesley.

• Corchado, J.M. (1998). Proyecto Docente. Universidad de Salamanca.

• De Miguel, P. (1992). Fundamentos de los Computadores. Ed. Paraninfo, Madrid.

• García-Beltrán, A. (2000). Proyecto docente. Universidad Politécnica de Madrid.

• Giarratano, J.C. (1984). Los Ordenadores. Fundamentos y Sistemas. Ed. Díaz de Santos.

• Knuth, D.E. (1986). El Arte de Programar Ordenadores. Vol. 1. Algoritmos Fundamentales. Ed. Reverté.

• Martínez, R. (1993). Proyecto docente. Universidad Politécnica de Madrid.

• Martínez, R. García-Beltrán, A. (2000). Breve historia de la informática. División de Informática Industrial

ETSI Industriales. Universidad Politécnica de Madrid.

• Ureña, L.A., Sánchez, A.M., Martín, M.T. y Mantas, J.M. (1997). Fundamentos de Informática. RA-MA.

• Wirth, N. (1986). Algoritmos + Estructuras de Datos = Programas. Ediciones del Castillo. Madrid.

-

Créditos

Escuela Preparatoria Núm. 3

Academia de Informática

Lic. en Comp. Marco Antonio Zamora Lucio

Compilador de contenidos

Centro de Cómputo Académico

M.C.T.E. Bertha Patricia Legorreta Cortés

Diseño instruccional

Estudiante LDG. Iván Marte Camargo Zavala

Estudiante LDG. Víctor Hugo Gómez SuarezIlustraciones y tratamiento de imágenes

El material utilizado en este documento es con fines educativos.

2016. Universidad Autónoma del Estado de Hidalgo. Derechos reservados.